Одномерное уравнение теплопроводности. Дзенушко Дайнис. 6 курс

Постановка задачи[править]

Необходимо решить задачу Коши для одномерного уравнения теплопроводности (дифференциальное уравнение в частных производных второго порядка, которое описывает распределение температуры в заданной области пространства и его изменение во времени.) с использованием средств параллельного программирования на основе MPI.

Задача решается для однородного уравнения теплопроводности (система теплоизолирована) на промежутке [0..L]:

при следующих граничных условиях:

Используемые величины параметров:

Используемый метод[править]

В вычислительных системах с распределенной памятью процессоры работают независимо друг от друга. Для организации параллельных вычислений в таких условиях необходимо иметь возможность распределять вычислительную нагрузку и организовать информационное взаимодействие (передачу данных) между процессорами. Параллельное программирование служит для создания программ, эффективно использующих вычислительные ресурсы за счет одновременного исполнения кода на нескольких вычислительных узлах. Для создания параллельных приложений используются параллельные языки программирования и специализированные системы поддержки параллельного программирования, такие как MPI и OpenMP. Итак, MPI - это библиотека передачи сообщений, собрание функций на C/C++ (или подпрограмм в Фортране), облегчающих коммуникацию (обмен данными и синхронизацию задач) между процессами параллельной программы с распределенной памятью. Акроним MPI установлен для Message Passing Interface (интерфейс передачи сообщений). Под параллельной программой в рамках MPI понимается множество одновременно выполняемых процессов. Все процессы порождаются один раз, образуя параллельную часть программы. Каждый процесс работает в своем адресном пространстве, никаких общих переменных или данных в MPI нет. Процессы могут выполняться на разных процессорах, но на одном процессоре могут располагаться и несколько процессов (в этом случае их исполнение осуществляется в режиме разделения времени).

Реализация[править]

При решении поставленной задачи будем использовать замену частных производных в дифференциальных уравнениях их разностными аналогами. Сеточный метод, основанный на замене в дифференциальном уравнении производных конечными разностями, называют методом конечных разностей, а сеточную схему такого метода - конечно-разностной.

Введем равномерную сетку с шагом разбиения , - шаг по времени. Явная конечно-разностная схема в таком случае будет выглять следующим образом:

Отрезок [0..L] разбивается на интервалы согласно количеству процессов в выполняемой параллельной программе. На каждом полученном таким способом интервале процесс интегрирования осуществляется отдельным процессом, при этом в связи с использованием явной схемы соседние процессы должны обмениваться крайними значениями, полученными на предыдущем шаге, для выполнения следующего шага.

Программа для решения одномерного уравнения теплопроводности:

Результаты[править]

Найдено решение однородного уравнения теплопроводности в одномерной постановке.

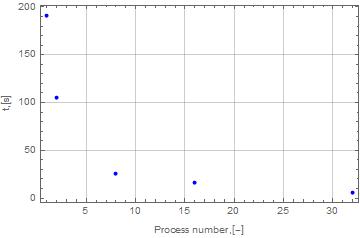

При расчете 1000000 узлов:

| Количество процессов [-] | Время рассчета [сек] |

|---|---|

| 1 | 191.617 |

| 2 | 105.329 |

| 8 | 25.3305 |

| 16 | 16.5349 |

| 32 | 6.34023 |

Показано, что при увеличении количества процессов уменьшается время расчета.Также из приведенного графика видно, что для малого числа узлов в сетке использование большого количества процессов не обосновано - выигрыш во времени незначителен.